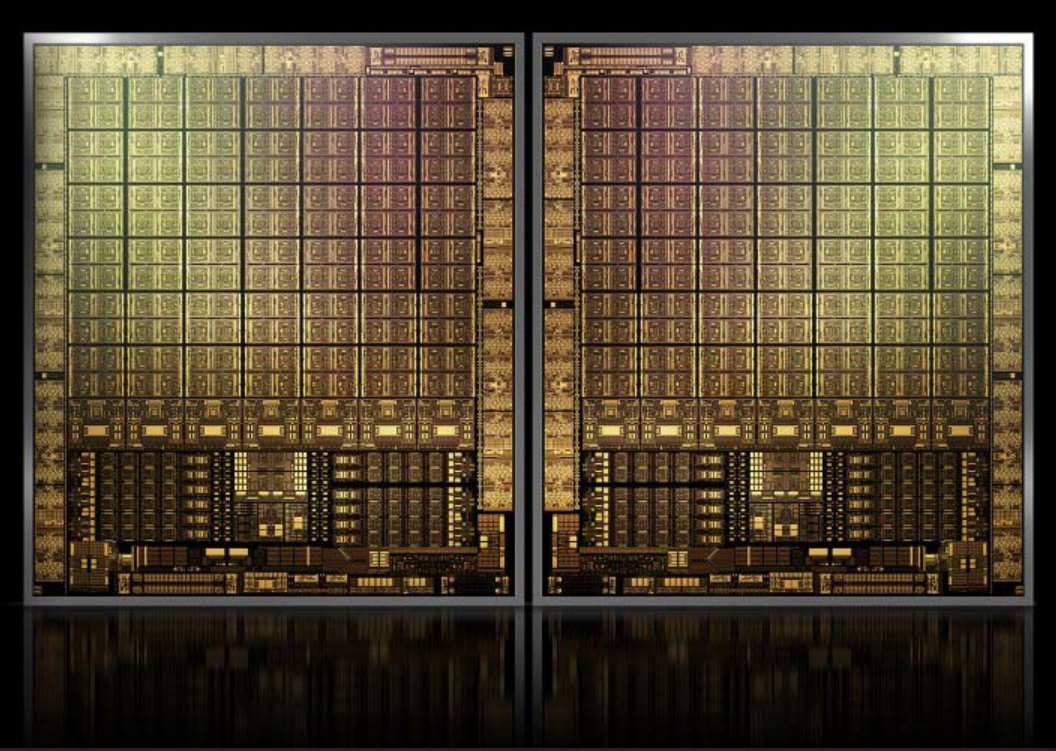

Es gab mal eine Zeit, da waren Computer und deren Rechenwerke so groß, dass man sie begehen konnte. Wenn Nvidia so weitermacht, könnten diese Zeiten wiederkommen. Immerhin soll der neue Hopper GPU-Chip für Rechenzentren, GH100, mit 900mm² Fläche der größte sein, den Nvidia jemals entwickelt hat.

Bereits Ende Januar berichtete die Seite wccftech.com über die enormen Ausmaße des neuen Chips. Inzwischen gibt es weitere Gerüchte über den kommenden Chip. So soll er über 140 Milliarden Transistoren beinhalten, was neben der Chipgröße auch dem 5nm-Prozess zu verdanken ist. Zum Vergleich: Nvidias aktuelles Flaggschiff, der GA 100, bringt es auf 54,2 Milliarden Transistoren. Das ist entspricht nicht nur der zweieinhalbfachen Menge an Transistoren – auch die Transistordichte hat sich mit rund 150 Millionen pro Quadratmillimeter verdoppelt.

Interessant dürfte sein, was Nvidia mit dem Platz bzw. den vielen Transistoren vor hat. Eine Möglichkeit wäre, einfach die Anzahl der Kerne zu erhöhen, den Vorgänger also hochzuskalieren. Wahrscheinlicher ist aber, dass Nvidia alles tun wird, um Intels Ponte Vecchio-Chip zu übertreffen und daher auf Kerne setzt, die dessen Stärken kontern. Dazu böten sich 64-Bit-Gleitkomma-Kerne an oder weitere Tensor-Recheneinheiten, die als Spezialisten für Matrixmultiplikationen vor allem bei Machine-Learning Anwendungen ihr Potenzial ausspielen können.

Für Gamer ist der Prozessor also nicht gedacht. Dennoch ist er indirekt auch für sie relevant: Vieles, was mit Data-Center-Prozessoren eingeführt wird, gelangt früher oder später auch in normale Grafikkarten. Sei es, weil einiges wiederverwendet werden kann und sich Nvidia dadurch Entwicklungskosten erspart, oder weil Machine Learning und künstliche Intelligenz auch in Computerspiele immer stärker Einzug halten und entsprechende Hardware so auch im Heimbereich gefordert wird.